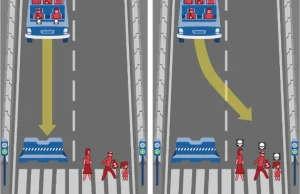

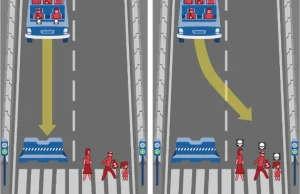

Moral Machine - "Zabić dwóch pasażerów czy pięciu przechodniów?"

Weź udział w prostym quizie i pomóż robotom (tu: samochodom autonomicznym) w podejmowaniu trudnych moralnie decyzji.

- #

- #

- #

- #

- #

- #

- 19

Weź udział w prostym quizie i pomóż robotom (tu: samochodom autonomicznym) w podejmowaniu trudnych moralnie decyzji.

Komentarze (19)

najlepsze

Algorytm którym się kierowałem:

1 Zabij jak najmniej ludzi.

2 Jeśli 1 kryterium nie daje rozstrzygnięcia stosuj się do obowiązujących przepisów.

3 Jeśli 1 i 2 nie dają rozstrzygnięcia ratuj siebie (właściciela/pasażera).

4 Jeśli nadal nie wiesz co robić jedź prosto i nie manewruj (może zareagują inni).

Tyle, że w wynikach wcale nie wyszło saving more lives maksymalnie po prawej a jedynie lekko na prawo

Moim zdaniem autonomiczne samochody mają tak jeździć by nikogo nie zabijać. I nie podejmować takich tematów. Wystarczy jechać ostrożnie,

A dla mnie najważniejsze było chronienie kierowcy/pasażerów. Ja płacę za samochód i ma być bezpieczny, reszta mnie nie obchodzi.

Następne rzeczy to prawo, czyli jeśli ktoś przepier... się na czerwonym to stworzył zagrożenie, jego błąd i głupota.

Ilość ludzi musiałem zobaczyć właściwie tylko raz bo oba zielone, na jednym dodatkowa osoba. A

Więc jeśli auto jedzie, a wpierniczy się ktoś na czerwonym, wybór jest dość prosty...